Desafíos Éticos de las Tecnologías Emergentes

Tema 1: Impacto ético de la inteligencia artificial (IA)

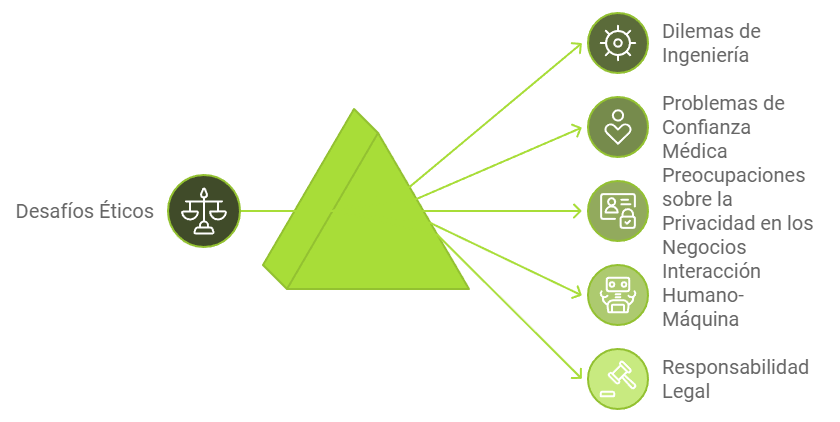

La IA afecta de manera transversal a múltiples disciplinas. En ingeniería, puede automatizar procesos críticos, pero plantea preguntas sobre el control humano, como en el diseño de sistemas de vehículos autónomos, donde se enfrentan dilemas sobre la seguridad del pasajero versus la de terceros. En medicina, la IA ayuda a diagnosticar enfermedades con mayor precisión, pero plantea dilemas sobre la confianza en la tecnología frente al juicio clínico. Un sistema automatizado de diagnóstico puede cometer errores que los médicos deben corregir, lo que lleva a preguntas sobre la responsabilidad ética y legal en el uso de IA en el cuidado de la salud. En el ámbito de los negocios, la IA mejora la eficiencia al predecir comportamientos del consumidor, pero también puede vulnerar la privacidad si no se regula adecuadamente, como sucede con las empresas que recopilan grandes cantidades de datos sin el consentimiento adecuado. Los diseñadores y comunicadores, por su parte, deben considerar cómo la IA afecta la interacción entre humanos y máquinas, asegurándose de que sea accesible y equitativa para todos los grupos sociales. Es esencial que en todas las disciplinas, la IA se utilice con principios éticos que respeten la dignidad humana, evitando la discriminación algorítmica o la dependencia excesiva de la tecnología. Para los futuros ingenieros, médicos, diseñadores y empresarios, entender cómo interactúa la IA con sus campos específicos es crucial para tomar decisiones éticas y justas. Un caso relevante para el derecho sería definir las implicaciones legales de las decisiones automatizadas: ¿quién es responsable si una IA causa daño? La regulación de IA es fundamental para establecer líneas claras de responsabilidad legal y ética.

Tema 2: Bioética y edición genética

La edición genética tiene implicaciones en biotecnología, medicina y nutrición, entre otras áreas. Para los biotecnólogos, el uso de herramientas como CRISPR plantea el desafío de equilibrar el avance científico con los riesgos éticos. Las modificaciones genéticas pueden generar beneficios, como la eliminación de enfermedades hereditarias, pero también abren la puerta a la posibilidad de editar características no relacionadas con la salud, lo que plantea riesgos de eugenesia moderna. Los médicos deben considerar el impacto a largo plazo de modificar el ADN de los pacientes, y cómo garantizar que las intervenciones genéticas sean terapéuticas y no mejorativas. En biotecnología, el desafío es garantizar que los experimentos con edición genética en plantas o animales no comprometan la biodiversidad ni causen un daño irreversible al ecosistema.

Los nutricionistas podrían ver aplicaciones en la mejora genética de cultivos, lo que afecta la seguridad alimentaria, pero deben preguntarse si las modificaciones genéticas son accesibles para toda la población o si crean desigualdades alimentarias. Desde una perspectiva legal, el derecho internacional aún debe ponerse al día con las implicaciones de la edición genética, especialmente en términos de protección de los derechos humanos y la dignidad de las personas modificadas genéticamente. Los abogados tienen un papel crucial en la creación de marcos legales que regulen estas intervenciones. En todos estos campos, es fundamental asegurar que las intervenciones genéticas respeten la dignidad humana y no conduzcan a desigualdades o usos no éticos. El debate sobre hasta dónde debe llegar la intervención genética está en el centro de la bioética contemporánea, especialmente cuando se trata de decisiones que afectarán a futuras generaciones. Los diseñadores, por su parte, también juegan un rol al crear interfaces para explicar estos procesos al público de forma comprensible y transparente..

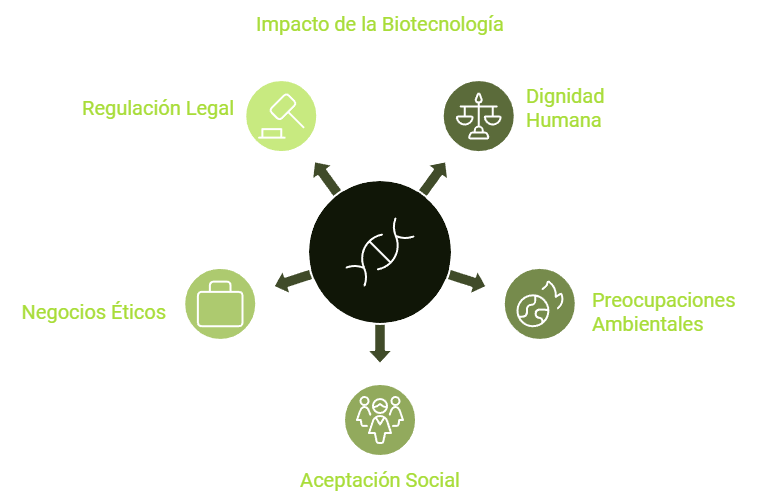

Tema 3: Biotecnología y su influencia en la dignidad humana

En biotecnología, la creación de organismos modificados genéticamente (OGM) ha transformado la agricultura, la medicina y la industria alimentaria, pero plantea preguntas sobre su impacto en la dignidad humana y el medio ambiente. Para los ingenieros y diseñadores, el reto es cómo implementar estas tecnologías de manera que respeten tanto la naturaleza como a las personas, garantizando la sostenibilidad. Un ejemplo claro son los biorreactores y sistemas agrícolas automatizados que requieren del conocimiento técnico de ingenieros, pero también una conciencia bioética para evitar la explotación desmedida de los recursos naturales. Desde la perspectiva de los psicólogos, la aceptación social y los efectos psicosociales de las tecnologías biotecnológicas en la vida diaria son temas clave, ya que el uso de OGM en los alimentos, por ejemplo, puede afectar la percepción de las personas sobre su salud y bienestar. En los negocios, las consideraciones sobre los monopolios tecnológicos y su influencia en la equidad deben ser abordadas éticamente. Las empresas que monopolizan las patentes biotecnológicas pueden limitar el acceso a estos avances, generando desigualdades en el acceso a recursos vitales como alimentos o tratamientos médicos.En términos legales, los abogados se enfrentan al reto de regular estas tecnologías para que no perjudiquen a las poblaciones más vulnerables ni causen daños ecológicos. Un equilibrio entre el desarrollo económico y el respeto por el medio ambiente es clave para mantener la dignidad humana intacta en la era biotecnológica.

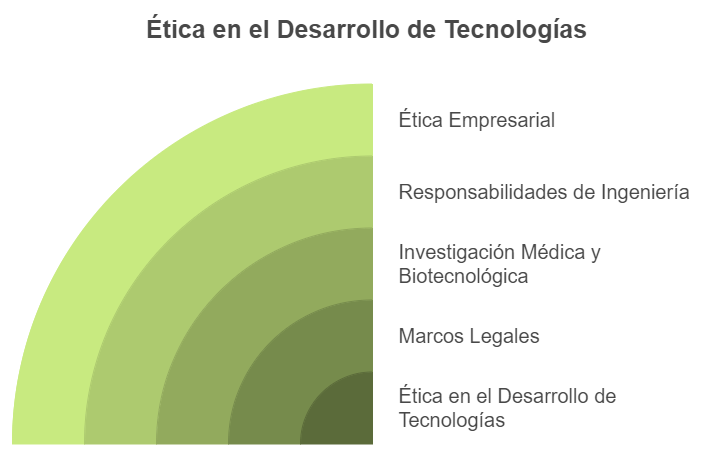

Tema 4: Ética en la investigación y desarrollo de nuevas tecnologías

La investigación en áreas como medicina, biotecnología e ingeniería impulsa avances tecnológicos, pero debe realizarse de manera ética. Para los estudiantes de derecho, es esencial comprender los marcos legales que regulan la investigación científica, como la Declaración de Helsinki, que establece principios para la investigación médica en humanos. Los médicos e investigadores biomédicos deben asegurarse de que sus estudios beneficien a la humanidad sin causar daño, respetando los principios de beneficencia y justicia. Esto incluye realizar ensayos clínicos éticos que no exploten a poblaciones vulnerables. Para los ingenieros, diseñar tecnologías emergentes, como dispositivos médicos o nuevos sistemas de transporte, implica tomar decisiones éticas que afecten la vida de las personas. Los ingenieros deben tener en cuenta cómo sus creaciones afectarán la salud, la seguridad y la privacidad de los usuarios. En el mundo de los negocios, la ética en la innovación es clave. Las empresas que desarrollan nuevas tecnologías deben asegurarse de que no solo sean rentables, sino también socialmente responsables. Un ejemplo es el desarrollo de medicamentos: las compañías farmacéuticas deben equilibrar la necesidad de innovación con el acceso asequible a tratamientos. Los diseñadores y comunicadores, por su parte, tienen la responsabilidad de traducir los avances tecnológicos en productos que sean comprensibles y accesibles para el público general, mientras que los abogados deben trabajar en la regulación de estas tecnologías para garantizar que se desarrollen de manera ética y justa.

Tema 5: Casos prácticos y análisis de dilemas éticos

Los casos prácticos permiten a los estudiantes de todas las disciplinas aplicar principios éticos en situaciones del mundo real.

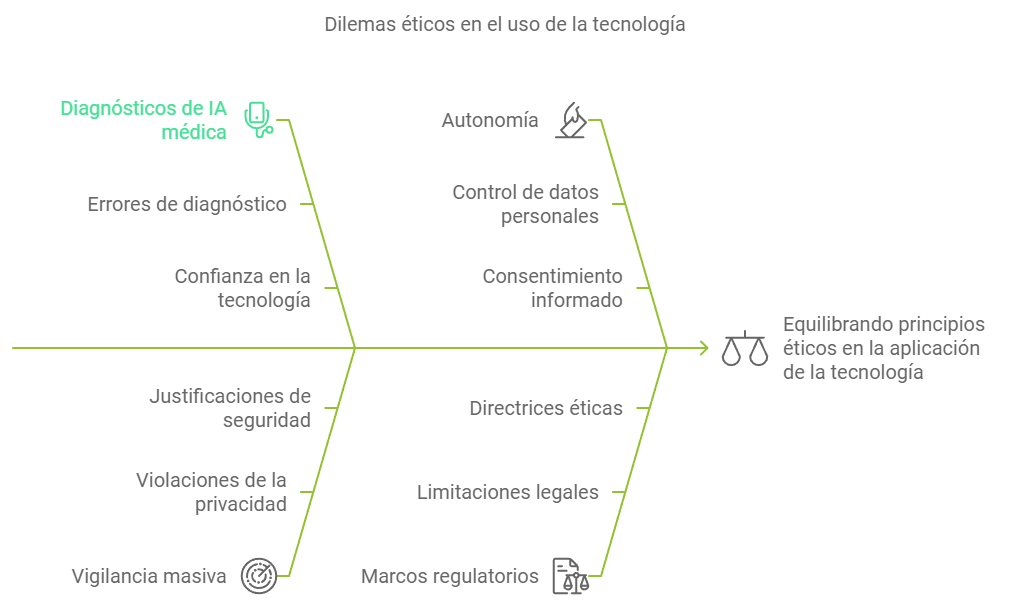

Caso 1: Inteligencia Artificial en Diagnóstico Médico

Un hospital ha implementado un sistema de inteligencia artificial (IA) para asistir a los médicos en la identificación temprana de cáncer de piel. Este sistema analiza imágenes de lesiones cutáneas y determina con alta precisión si son malignas o benignas. Sin embargo, en algunos casos, el sistema ha proporcionado diagnósticos erróneos, ya sea sobreestimando el riesgo de malignidad o minimizándolo. Los médicos deben decidir hasta qué punto confiar en el sistema y cuándo realizar un diagnóstico basado en su propio criterio.

Dilema ético:

Autonomía vs. Confianza en la Tecnología: ¿Debería un médico seguir las recomendaciones de la IA si su propio juicio clínico sugiere lo contrario? ¿Hasta qué punto es ético delegar decisiones críticas de salud a una máquina?

Beneficencia y no maleficencia: Si la IA mejora la precisión en la mayoría de los casos, ¿es ético utilizarla a pesar de que ocasionalmente pueda dar resultados incorrectos que podrían llevar a intervenciones innecesarias o retrasos en el tratamiento?

Análisis:

El uso de IA en medicina presenta una tensión entre la autonomía del médico y la confianza en la tecnología. En este caso, la IA puede aumentar la eficiencia y precisión diagnóstica, pero los médicos deben seguir siendo responsables de las decisiones finales, asegurándose de que la tecnología actúe como un apoyo, no como un sustituto. Es crucial implementar salvaguardias éticas que permitan revisar y corregir los posibles errores de la IA, evitando el daño a los pacientes.

Caso 2: Vigilancia Masiva y Privacidad en el Ámbito Legal

Un gobierno ha implementado un sistema de vigilancia masiva que utiliza cámaras de reconocimiento facial en espacios públicos para aumentar la seguridad y prevenir delitos. Sin embargo, este sistema también permite rastrear los movimientos de cualquier ciudadano, incluso si no está involucrado en actividades criminales. Los defensores de la privacidad argumentan que esta tecnología viola los derechos fundamentales de las personas, mientras que las autoridades defienden su uso como una herramienta para mejorar la seguridad pública.

Dilema ético:

Derecho a la privacidad vs. Seguridad: ¿Es ético sacrificar el derecho a la privacidad de los ciudadanos en nombre de la seguridad pública? ¿Hasta qué punto puede el Estado vigilar a sus ciudadanos sin violar los derechos humanos?

Consentimiento y Autonomía: ¿Los ciudadanos deben consentir activamente ser vigilados o es suficiente con que las autoridades lo justifiquen por razones de seguridad? ¿Qué implicaciones tiene para la autonomía personal si los ciudadanos no tienen control sobre quién y cómo se recopilan sus datos?

Análisis:

Este caso plantea un conflicto entre el derecho a la seguridad y el derecho a la privacidad, ambos principios fundamentales en las sociedades democráticas. Si bien la tecnología de vigilancia puede prevenir delitos, su uso desmedido puede llevar al abuso de poder y a la erosión de las libertades civiles. Desde una perspectiva legal, es esencial regular la vigilancia masiva para garantizar que los derechos humanos no se vean comprometidos. El principio de autonomía demanda que los individuos tengan la capacidad de controlar el uso de sus datos, mientras que el derecho a la privacidad debería ser protegido frente a tecnologías intrusivas.

Estos dos casos invitan reflexionar sobre cómo aplicar principios bioéticos como la justicia, la no maleficencia, el respeto por la dignidad humana en el contexto de la tecnología y en el uso de tecnologías de vigilancia en el ámbito legal. Ambos subrayan la necesidad de establecer marcos regulatorios y éticos claros para proteger los derechos humanos y la dignidad de las personas en un mundo cada vez más influenciado por la tecnología.

Podcast

En resumen

¡Enhorabuena!