Dignidad

La inteligencia artificial generativa (IAG) está transformando la educación en todo el mundo. Sus capacidades para personalizar experiencias de aprendizaje, generar contenido automáticamente y optimizar tareas son innegables. Sin embargo, su implementación en el aula plantea desafíos éticos importantes, especialmente en relación con la dignidad humana. Como docentes, tenemos la responsabilidad de garantizar que el uso de la tecnología respete y promueva la dignidad de cada estudiante, evitando prácticas deshumanizadoras o discriminatorias. En esta sección, exploraremos cómo la IAG puede integrarse en la educación manteniendo un compromiso ético con la dignidad humana, en línea con los valores de nuestra institución y los principios éticos.

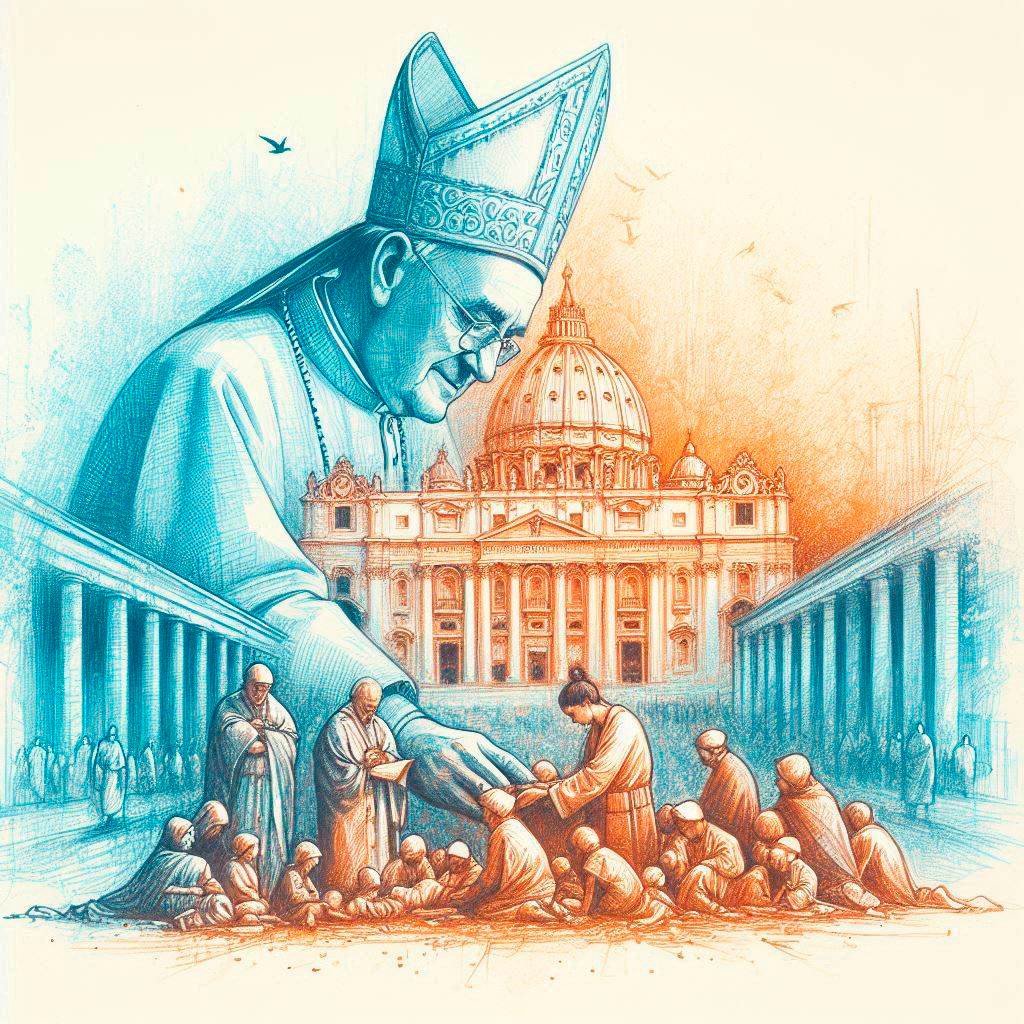

La Dignidad Humana: Un Pilar Fundamental en la Educación

La dignidad humana es un principio inalienable y universal que establece que cada persona tiene un valor intrínseco que debe ser respetado en cualquier circunstancia. En el ámbito educativo, este principio guía nuestras interacciones con los estudiantes y es el eje de cualquier innovación tecnológica que introduzcamos en el aula. El uso de IAG no debe ser la excepción.

Desde un punto de vista filosófico y teológico, la dignidad de cada ser humano implica reconocer su singularidad y valor. Esta visión ha sido consistentemente subrayada en documentos del Vaticano, que enfatizan que la tecnología, incluido el uso de la IA, debe estar al servicio de la humanidad, no al revés (Vaticano, 2023). En la educación, esto significa que la IA debe ser una herramienta que complemente y potencie el proceso de enseñanza, pero nunca debe sustituir la relación personal entre docentes y estudiantes o comprometer la integridad y respeto hacia los individuos.

El Impacto de la IA en la Dignidad Estudiantil

Al integrar la IA en nuestras prácticas educativas, es esencial que consideremos el impacto que esta tecnología puede tener en la dignidad de los estudiantes. Aunque la IA puede automatizar tareas y hacer más eficiente la enseñanza, existe el riesgo de que su uso deshumanice ciertas interacciones o genere decisiones injustas basadas en algoritmos sesgados.

1. Deshumanización en la Educación Automatizada

Uno de los riesgos inherentes al uso de la IAG es la deshumanización del proceso educativo. Si bien la automatización puede mejorar la eficiencia en ciertas áreas, es crucial que no reemplace el contacto humano necesario para un aprendizaje integral. El aprendizaje no es solo la transmisión de información; implica también el acompañamiento, la empatía y el entendimiento personal entre docente y estudiante.

Al depender demasiado de la IA para tareas como la evaluación o la retroalimentación, corremos el riesgo de que las interacciones se vuelvan impersonales y mecánicas, lo que podría afectar negativamente la relación de confianza y respeto mutuo que es esencial en el proceso educativo. El Vaticano ha advertido sobre este riesgo, señalando que el uso de tecnología no debe sustituir el trato humano, sino que debe ser un complemento que fortalezca las relaciones humanas (Vaticano, 2023).

2. La IA y la Autonomía Estudiantil

Otro aspecto crítico es cómo la IA afecta la autonomía de los estudiantes. La educación debe ser un proceso que fomente la capacidad de los estudiantes para tomar decisiones informadas y actuar con independencia. Sin embargo, cuando se utiliza IA para guiar y automatizar el aprendizaje, existe el riesgo de que los estudiantes se vuelvan dependientes de estas tecnologías, disminuyendo su capacidad para pensar críticamente o tomar decisiones autónomas.

Sesgos en los Algoritmos: Un Riesgo para la Dignidad

Uno de los mayores desafíos en el uso de IA en la educación es el riesgo de sesgo algorítmico. Los algoritmos de IA se entrenan con grandes volúmenes de datos, que a menudo reflejan las inequidades y prejuicios presentes en la sociedad. Si estos sesgos no se corrigen, la IA puede replicar o incluso amplificar las desigualdades, afectando de manera desproporcionada a ciertos grupos de estudiantes.

1. Impacto del Sesgo Algorítmico en las Evaluaciones

La evaluación es una de las áreas en las que la IA generativa puede tener un impacto más significativo, y también donde el sesgo algorítmico puede tener consecuencias más graves. Si un algoritmo ha sido entrenado con datos que reflejan prejuicios históricos o sociales, puede hacer juicios erróneos sobre el desempeño de los estudiantes. Esto podría resultar en calificaciones injustas o en un trato desigual, lo que compromete la dignidad del estudiante al no ser evaluado de manera justa y equitativa.

2. Transparencia y Responsabilidad en el Uso de IA

Uno de los principios fundamentales para proteger la dignidad de los estudiantes es la transparencia en el uso de la tecnología. Los estudiantes tienen derecho a saber cómo se están utilizando sus datos y de qué manera se toman las decisiones que afectan su aprendizaje y su evaluación. Si la IA se está utilizando para automatizar evaluaciones o proporcionar retroalimentación, es importante que los estudiantes comprendan el proceso y sepan cómo corregir cualquier posible error o sesgo que pueda surgir.

La responsabilidad también es clave. Como docentes, no debemos delegar la totalidad de la toma de decisiones a la IA. Aunque la tecnología puede ser útil para realizar tareas rutinarias, es fundamental que mantengamos nuestro rol como garantes de la equidad y la justicia en el aula. El juicio humano es insustituible cuando se trata de garantizar que cada estudiante sea tratado con dignidad y respeto (EU AI Act, 2024).

Buenas Prácticas para Garantizar la Dignidad en el Uso de IA

Para asegurarnos de que la IA generativa respete la dignidad de los estudiantes, es fundamental seguir una serie de buenas prácticas. Estas prácticas no solo se alinean con los valores institucionales, sino también con la visión ética del Vaticano y los estándares internacionales sobre el uso de la IA.

1. Supervisión Humana en la Toma de Decisiones

La tecnología puede ser una gran aliada en la automatización de procesos, pero las decisiones finales deben ser siempre revisadas y validadas por humanos. Esto es especialmente importante en evaluaciones, calificaciones o cualquier aspecto del aprendizaje que tenga un impacto directo en el estudiante. Mantener la supervisión humana garantiza que las decisiones respeten la dignidad individual de cada estudiante y que cualquier error generado por la IA sea corregido a tiempo.

2. Fomentar la Inclusión y la Equidad

El acceso a la tecnología puede ser desigual, y como docentes, debemos asegurarnos de que el uso de la IA no excluya ni discrimine a ningún estudiante. La IA debe ser una herramienta para empoderar a todos, independientemente de sus recursos o capacidades, y es nuestra responsabilidad garantizar que se utilice de manera inclusiva. Proveer acceso igualitario a las herramientas tecnológicas y asegurar que todos los estudiantes comprendan y puedan beneficiarse de ellas es esencial para promover la equidad en el aula.

3. Capacitación y Alfabetización Tecnológica

Una parte fundamental de garantizar un uso ético y respetuoso de la IA es la formación. No solo los docentes debemos estar bien capacitados en el uso ético de la IA, sino que también debemos educar a los estudiantes sobre cómo funciona esta tecnología, sus limitaciones y los riesgos asociados. Al proporcionar una educación sólida en alfabetización tecnológica, empoderamos a los estudiantes a utilizar la IA de manera crítica y responsable, promoviendo así su autonomía y su dignidad.

El Rol del Docente en la Promoción de la Dignidad a Través de la Tecnología

El papel del docente en la integración de IA generativa no es solo técnico, sino profundamente moral y ético. En un contexto donde la tecnología se vuelve más omnipresente, el docente se convierte en el guardián de los valores humanos en el aula. Esto implica no solo supervisar la tecnología, sino también promover una cultura de respeto, equidad y justicia en la interacción diaria con los estudiantes.

1. Promoción de un Entorno Ético

Para garantizar que la dignidad de los estudiantes sea respetada, los docentes debemos crear un entorno donde la tecnología no sea vista como una solución definitiva, sino como un complemento de las interacciones humanas que son esenciales en el proceso educativo. Fomentar un entorno ético implica también establecer y comunicar normas claras sobre el uso de la tecnología, explicando a los estudiantes cómo la IA puede y no debe ser utilizada en el aula. Es importante recordar que el uso responsable de la tecnología empieza por nosotros, los docentes, quienes debemos dar el ejemplo al utilizar IA de manera ética y respetuosa.

2. Promoción de la Reflexión Crítica en los Estudiantes

Es fundamental que los estudiantes sean conscientes de los impactos y limitaciones de la IA. Como docentes, debemos fomentar la reflexión crítica en torno a la tecnología, para que los estudiantes no la vean simplemente como una herramienta eficiente, sino también como una tecnología que requiere ser usada con precaución y ética. Esto no solo protege su dignidad, sino que también los prepara para un mundo en el que la IA jugará un papel cada vez más importante.

3. El Cuidado de la Privacidad como Protección de la Dignidad

La privacidad es una extensión de la dignidad. Cualquier tecnología que recopile datos personales debe ser utilizada con total responsabilidad. La recolección de información personal y el manejo de datos sensibles deben cumplir con las normativas de protección de datos, tal como lo exige el Reglamento General de Protección de Datos (GDPR) y otras legislaciones locales. Asegurarnos de que los datos de los estudiantes sean tratados de manera confidencial y segura no solo protege su privacidad, sino que también refuerza el respeto por su dignidad personal.

El Vaticano y la Visión de la Dignidad Humana en la Era Digital

La visión del Vaticano en relación con la tecnología ha sido clara en cuanto a la importancia de poner siempre al ser humano en el centro de cualquier innovación tecnológica. En documentos recientes, el Vaticano ha enfatizado que el progreso tecnológico debe estar al servicio del bien común y que la dignidad de la persona humana no debe ser comprometida por el uso indiscriminado de la tecnología (Dignitas Infinita Vaticano, 2023). Esto es particularmente relevante en el contexto de la educación, donde la IA se está integrando de manera acelerada.

1. Principios Éticos del Vaticano para el Uso de Tecnología en la Educación

El Vaticano plantea tres principios fundamentales que deben guiar el uso de la IA en la educación:

- Primacía de la Persona: La tecnología debe estar siempre al servicio de la persona, no al revés. En la educación, esto significa que la IA debe ser una herramienta que complemente, pero no reemplace, la interacción humana entre docentes y estudiantes.

- Equidad y Justicia: El uso de IA debe promover un acceso igualitario a la educación y no debe perpetuar desigualdades. Es necesario asegurar que la IA no introduzca sesgos que afecten negativamente a ciertos grupos de estudiantes.

- Transparencia y Responsabilidad: Los sistemas de IA deben ser transparentes en cuanto a cómo funcionan y cómo se toman las decisiones. Además, los educadores deben ser responsables del uso que hacen de la IA, asegurando que no comprometa la dignidad de los estudiantes.

Estos principios éticos están alineados con los valores institucionales de muchas universidades y sistemas educativos, que ven en la IA una oportunidad para mejorar la educación, pero siempre desde un enfoque basado en la dignidad y el respeto.

Desafíos Futuros y Conclusiones

El uso de IA generativa en la educación presenta grandes oportunidades, pero también plantea desafíos significativos en relación con el respeto a la dignidad humana. A medida que esta tecnología siga avanzando, será esencial que los docentes y las instituciones educativas adopten un enfoque basado en principios éticos sólidos, asegurando que la IA esté al servicio de la educación y no al revés.

Finalmente, los valores institucionales ofrecen una guía clara: la tecnología debe estar al servicio del ser humano, promoviendo el bien común y protegiendo siempre la dignidad de cada individuo. Este enfoque es el que debe guiar nuestras decisiones a la hora de integrar la IA en nuestras aulas, garantizando una educación que no solo sea innovadora, sino también profundamente humana y respetuosa.

Podcast

En resumen

¡Enhorabuena!

- UNESCO. (2023). Ethical AI: Guidelines and Policies. United Nations Educational, Scientific and Cultural Organization.

- Vaticano. (2023). Dignitas Infinita: Reflexiones sobre la dignidad humana en la era de la IA. Pontificia Academia para la Vida.

- Pontificia Academia para la Vida. (2023). What Matters with AI Ethics: A Moral Perspective. Vatican City.